有着AI领域“最强卖铲人”称号的芯片巨头英伟达(NVDA.US) 真乃“又双叒叕”公布了强劲无比的季度业绩以及大幅超出市场预期的业绩展望。随着具有划时代意义的生成式AI——ChatGPT横空出世,意味着全球逐步迈入全新的AI时代,此后不仅是科技行业,全球各行各业对英伟达AI芯片——即用于AI训练与推理领域的A100/H100芯片需求激增,使得该科技巨头继之前三个季度之后,又一次发布了令全球震惊的强劲无比业绩数据。

在截至1月28日的2024财年第四季度,英伟达总营收规模增加了两倍多,达到221亿美元。扣除某些项目后,NON-GAAP准则下的每股收益为5.16美元,均大幅超过华尔街分析师普遍预测的204亿美美元以及每股收益4.60美元。更重要的是,英伟达预计本季度总营收将再次大幅增长,这有助于证明其股价大涨趋势完全合理,使其继续成为全球最有价值的公司之一。

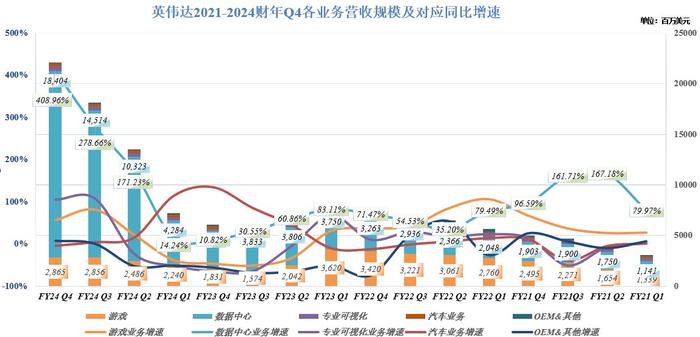

总营收凸显出英伟达业绩连续增长规模:就在2021财年,英伟达一整个财年的总营收也未能达到这一数值。此外,英伟达最核心业务部门,即为全球数据中心提供A100/H100芯片的业务部门——数据中心业务部门,Q4营收规模达到约184亿美元,同比激增409%。

继2023年股价暴涨240%之后,2024年迄今英伟达股价涨幅高达40%。英伟达市值今年增加了4000多亿美元,使其总市值达到1.67万亿美元,投资者们押注该公司仍将是人工智能计算热潮的最主要受益者。

英伟达首席执行官黄仁勋表示:"GPU加速计算和生成人工智能可谓已经达到‘临界点’。"“全球各公司、行业,乃至多数国家的需求都在激增。“

在与华尔街分析师的业绩电话会议上,黄仁勋表示,今年剩余时间,英伟达最新产品将继续供不应求。他表示,尽管供应在不断增长,但需求并没有显示出任何程度的放缓迹象。“生成式人工智能开启了一个全新的投资周期。”黄仁勋表示。他预计:“未来数据中心基础设施规模将在五年内翻番,代表着每年数千亿美元的市场机会”。

关于中国市场,黄仁勋表示,该公司已开始向中国市场的客户派送符合限制政策的新芯片样品。这应该有助于中国业务再次复苏。“我们将尽最大努力在该市场竞争并取得成功。”黄仁勋强调。

英伟达无比炸裂的业绩公布后,盘后股价一度暴涨超11%,美股芯科技股,尤其是芯片股板块盘后集体暴涨,要知道自本周以来,这些与AI相关的科技股与芯片股持续疲软,主要因全球资金在英伟达财报公布前的谨慎情绪。因此,AI芯片领域“最强卖铲人”英伟达可谓以一己之力重振全球科技股投资者们的“AI信仰”,科技股投资者们对于AI的信仰或许将在全球股市再度掀起巨大波浪。

来自华尔街知名投资机构Wolfe Research的分析师克里斯·卡索(Chris Caso)在一份报告中表示:“全球股票市场都在关注这份报告,因此预期也有所提高,但是英伟达公布的业绩展望足够强劲,显示股价涨势合理,同时也为下半年的持续上涨留下了空间。”

但是毋庸置疑的是,AI芯片领域竞争将变得愈发激烈。英伟达最强竞争对手AMD(AMD.US)最近开始销售MI300系列的AI GPU加速器,AMD预计今年将从该系列产品中获得35亿美元营收,高于此前预测的20亿美元。AI芯片初创企业后续也将是英伟达有力挑战者,近日Groq推出自研LPU,文本生成速度甚至比眨眼还快,推理性能则比英伟达GPU快10倍。但英伟达并未停滞不前,分析师们预计,该公司即将量产性能更强大的AI芯片H200,以及备受瞩目的B100。

英伟达——当前AI领域最强买铲人

最新业绩证明,英伟达仍然为全球AI领域当之无愧的“最强卖铲人”,靠着在AI训练领域高达90%的份额,乘着全球企业布局AI的前所未有热潮疯狂吸金。比如,上述Groq推出的LPU目前更加适用于推理,要想训练大语言模型,仍然需要大批量购买英伟达GPU。

英伟达很早就认识到GPU在AI和深度学习领域的潜力,因此投入大量资源进行相关研发,并成功构建了围绕其GPU硬件的强大软硬件生态系统。

英伟达在全球高性能计算领域已深耕多年,尤其是其一手打造的CUDA运算平台风靡全球,可谓AI训练/推理等高性能计算领域首选的软硬件协同系统。英伟达当前最火爆的AI芯片H100 GPU加速器则基于英伟达突破性的Hopper GPU架构,提供了前所未有的计算能力,尤其是在浮点运算、张量核心性能和AI特定加速方面。

ChatGPT开发者OpenAI、美国科技巨头亚马逊(Amazon.com Inc.)、Facebook与Instagram母公司Meta Platforms、特斯拉、微软以及谷歌母公司Alphabet都是英伟达最大规模客户,占其总营收规模近50%,它们当前正倾尽全力投资与人工智能算力相关的硬件,比如英伟达AI芯片。

特斯拉CEO马斯克将科技企业的人工智能军备竞赛比作一场高风险的“扑克游戏”,即企业需要每年在人工智能硬件上投入数十亿美元,才能保持竞争力。这位亿万富翁表示,在2024年,特斯拉仅仅在英伟达的人工智能芯片上就将耗费超过5亿美元,但他警告称,特斯拉未来还需要价值“数十亿美元”的硬件才能赶上一些最大规模的竞争对手。

随着全球迈入AI时代,数据中心业务已经成为英伟达最核心业务,而不是此前重度依赖游戏显卡需求的游戏业务。英伟达在细分业务方面,英伟达为全球数据中心提供A100/H100芯片的业务部门——数据中心业务部门,曾经可谓是英伟达“副业”(自英伟达创立之处,游戏业务一直是英伟达的最重要业务),已经成为该科技巨头整体营收的最强大贡献力量。

英伟达的数据中心业务部门多个季度以来均为所有业务中表现最出色的部门,数据中心业务Q4创造的营收达到184亿美元,较上年同期激增约409%。此外,英伟达预计,未来数据中心基础设施规模将在五年内翻番。与此同时,该公司游戏业务部门受益于全球芯片需求复苏趋势,创造的营收同比增长56%,至29亿美元。

英伟达目前正致力于将其人工智能软硬件生态推广到大型数据中心之外。61岁的黄仁勋近期周游世界,认为各国政府均需要主权级别的人工智能系统,既能保护数据,又能获得AI竞争优势。

黄仁勋在近期首提“主权AI能力”,暗示国家级人工智能硬件需求激增。黄仁勋表示,当今世界各国都打算在本国国内建立和运行自己的人工智能基础设施,这将全面推高对英伟达硬件产品的需求。黄仁勋近期在接受采访时表示,包括印度、日本、法国和加拿大在内的国家都在谈论投资“主权人工智能能力”的重要性。

业绩预期方面,全球市值最高芯片公司英伟达在业绩展望部分表示,该公司2024财年Q4(截至2024年4月底)总营收将达到约240亿美元。这一数据可谓大幅超越219亿美元的华尔街分析师平均预测数据。这一强劲无比的业绩前景凸显出英伟达位列全球企业布局AI热潮的最佳受益者,堪称AI核心基础设施领域的“最强卖铲人”。

面对消费者对ChatGPT以及谷歌Bard等生成式人工智能产品,以及其他企业AI软件等日益重要的AI辅助工具的需求激增,来自全球各地的科技巨头以及数据中心运营商正在竭尽全力储备该公司的H100 GPU加速器,H100可谓极度擅长处理人工智能训练/推理所需的繁重工作负载。

AI时代最核心基建之一——GPU

随着全球迈入AI时代以及万物互联进程加速,意味着全球算力需求迎来爆炸式增长,尤其是基于AI训练领域的各项AI细分任务涉及大量的矩阵运算、神经网络的前向和反向传播等对硬件性能要求极高的计算密集型高强度操作。然而,这些难题远非享受摩尔定律红利多年的CPU所能够解决。哪怕大量CPU也无法解决这一问题,毕竟 CPU设计初衷是在多种常规任务之间进行通用型计算,而不是处理天量级别的并行化计算模式以及高计算密度的矩阵运算。

更重要的是,随着全球芯片领域的创新与发展步入“后摩尔时代”(Post-Moore Era),作为曾推动人类社会发展主力军的CPU已经无法实现像22nm-10nm那样在不到5年间实现“阔nm”级别的快速突破,后续nm级别突破面临量子隧穿以及巨额投资规模等重重阻碍,这也使得CPU性能升级和优化层面面临极大限制。

因此,拥有大量计算核心、能够同时执行多个高密集型AI任务,并且极度擅长处理并行计算的GPU近年来成为芯片领域的最核心硬件。GPU在AI训练/推理等高性能计算领域有着其他类型芯片难以企及的巨大优势,这对于那些极其复杂的AI任务非常重要,比如图像识别、自然语言处理和大量矩阵运算等。现代GPU架构更是经过AI针对性优化,适用于深度学习等AI任务。例如,英伟达Tensor Cores 可以加速矩阵乘法和卷积计算等非常关键的高强度操作,它们能够并行化处理大规模的浮点和整数矩阵计算,从而提高计算效能。

自ChatGPT问世以来,随着AI对于全球高科技行业和技术发展的影响力度越来越大,专注于单线程性能与通用型计算的CPU仍是芯片领域不可或缺的一环,但其在芯片领域的地位和重要程度已远不及GPU。

从理论层面来看,摩尔定律所预言的性能指数级增长趋势近几年来并没有消失,而是从CPU转到了基于大量核心的GPU。近年来GPU性能仍在遵循性能指数增长规律,大约2.2年性能就会翻倍。相比之下,英特尔CPU GFLOPs仍呈增长趋势,但是与GPU GFLOPs相比似乎成了一条直线。

黄仁勋强调,全球向人工智能的转变现在才刚刚开始。他认为,通过将特定任务分解成更小的部分并且进行并行处理来加速特定任务的加速计算正在占据主导地位。从市场规模预期来看,知名市场研究机构Mordor Intelligence最新研究显示,预计GPU市场规模(涵盖PC、服务器、高性能计算、自动驾驶等应用端GPU) 未来五年将达到大约2069.5亿美元,预测期内(2024-2029年)复合增速(CAGR)高达32.70%。

Mordor Intelligence表示,GPU硬件不仅用于渲染图像、动画和电子游戏,还用于一般性的计算目的,几乎部署在全球所有计算型设备中。个人电脑、笔记本电脑和新兴应用(例如 AR/VR、高性能计算、人工智能、机器学习、区块链、加密货币挖掘、自动驾驶和高精度导航(车辆、机器人)的积极部署趋势,尤其是人工智能领域,未来将极大力度推动GPU需求。

业绩公布前夕,华尔街顶流们纷纷看涨英伟达

在英伟达最新业绩以及业绩展望出炉之前,华尔街最顶级投资机构们可谓纷纷看涨英伟达未来12个月的股价走势。

其中,华尔街大行高盛将该机构对英伟达的12个月目标股价从625美元大幅上调至800美元,美国银行将英伟达目标股价由700美元上调至800美元,瑞银将其目标股价从580美元上调至850美元。瑞穗证券将英伟达目标股价从625美元上调至825美元

一些机构甚至在财报出炉前,对英伟达未来12个月股价预期超1000美元。Rosenblatt重申英伟达“买入”评级, 目标价定为1100美元,Loop Capital对于英伟达的目标股价则高达1200美元,为华尔街最高目标价。

Loop Capital的分析师们表示,之所以给出如此高的目标价,是因为随着投资者继续对其人工智能芯片需求前景极度乐观,以及超大规模计算中心和数据中心向GPU系统的转变趋势,相信英伟达正处于多年周期的“前端”。 Loop Capital分析师们将这一现象比作90年代中后期“互联网建设基调”——从1995年到2001年互联网采用率扩大了五倍。

毋庸置疑的是,AI芯片领域竞争将变得愈发激烈

随着英伟达最强竞争对手AMD最近开始销售MI300系列的AI GPU加速器,以及近日推出自研LPU的AI芯片Groq闪亮登场,再加上谷歌等云计算巨头持续专注于主攻AI加速方面的ASIC芯片,即在自研AI芯片方面持续发力,AI芯片领域竞争后续将变得愈发激烈。

英伟达并未停滞不前,分析师们预计,该公司即将量产性能更强大的AI芯片B100。华尔街大行摩根士丹利认为,英伟达未来的产品营收规模也值得期待,预计B100将成为人工智能游戏规则的改变者,其影响力甚至将比上一代旗舰AI芯片H100更强大。

英伟达B100原计划发布时间为2024年年末,但由于AI 芯片需求过于火爆,已经提前至2024上半年,据知情人士透露,目前已经进入供应链认证阶段。

B100 将能够轻松应对1730 亿参数的大语言模型,比当前型号H200 的两倍还要强大。此外,B100 将采用更高级的HBM 高带宽内存规格,有望在堆叠容量和带宽上继续突破,超越现有的4.8TB/s。

B100 AI GPU将采用先进的技术,包括预计拥有1780亿个晶体管,以及最新的HBM3e存储技术,相较于H100的HBM3存储技术,这意味着在数据处理能力和存储能力上都将有大幅提升。B100的推出还意味着英伟达力求在还未占据全面优势AI推理领域发力,具体到AI推理性能上,B100将比现有的H100 AI GPU快4倍以上,这表明B100将在已训练模型的推理任务方面具有显著的优势。

此外,B100还预计将采用芯片组设计(即chiplet 设计),这是英伟达首次在其GPU产品中采用此技术。根据英伟达产品路线图,预计2025 年将推出X100,进一步丰富GPU 产品矩阵,巩固英伟达AI 芯片龙头地位。

一个月后,在当地时间3月18日,英伟达将举办面向AI开发者的2024年GTC ,届时英伟达CEO黄仁勋将进行主题演讲,可能会释出更多有关B100的新细节。一直看好英伟达的美国银行分析师Vivek Arya认为,预计英伟达即将推出的B100 GPU定价将比H100至少高出10%至30%。

[免责声明]如需转载请注明原创来源;本站部分文章和图片来源网络编辑,如存在版权问题请发送邮件至398879136@qq.com,我们会在3个工作日内处理。非原创标注的文章,观点仅代表作者本人,不代表本站立场。