在刚过去不久的 Microsoft Ignite 2023 大会上,微软一口气扔出了多颗「炸弹」。

首先是两款新芯片,一款是基于 arm 的 CPU,一款是自研 AI 芯片;其次是将 Bing Chat 更名为 Microsoft Copilot,至此完成了 AI 产品的全面 Copilot 化;最后是推出了允许任何人自定义 AI 对话机器人的 Copilot Studio。

毫不夸张地说,这场大会让微软再一次登上了神坛。毕竟在过去几个月间,OpenAI 推出了一系列的更新和计划,重新抓住了全世界的目光。

但如果说生成式 AI,甚至 AI 的未来就集中在了微软和 OpenAI 两家公司上,英伟达的可能是第一个不服的。就在 Ignite 大会上,微软 CEO 纳德拉邀请英伟达创始人兼 CEO 黄仁勋上台,并问了一个问题:

AI 的未来会走向何方?

老黄表示,生成式 AI 是过去 40 多年计算历史中最重要的一次范式转换,比 PC、移动设备乃至互联网都要来得更大。以 OpenAI GPT 引发的大模型「爆发」可以视为生成式 AI 的第一波浪潮;第二波则是微软当下正在实践的 Copilot 模式。

图/ YouTube@微软

而第三波也是最大的一波,将是英伟达的 Omniverse 与生成式 AI 相结合帮助重工业实现数字化,「世界上绝大多数工业都依赖于重工业,」老黄解释。

这不是英伟达第一次强调 Omniverse 与生成式 AI 的结合。

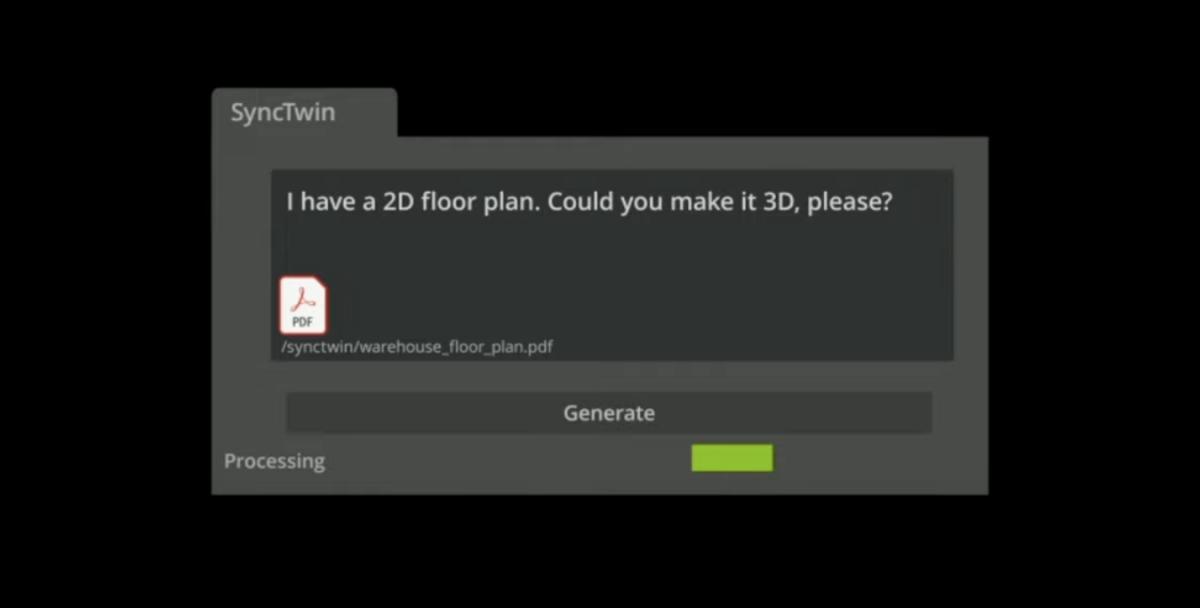

今年 8 月的图形技术顶会 SIGGRAPH 上,英伟达就大谈特谈生成式 AI 与 Omniverse 的结合,并展示了一个「从 PDF 到工厂」的 demo。简单来讲,英伟达把「建工厂」——一个复杂的工程「搬到」了数字世界,利用生成式 AI 与图形技术将 2D 平面图转为 3D 模型,再加入光照、纹理以及大量的信息,最终打造出工厂的「数字孪生」版本。

「虚拟工厂」,图/英伟达

而另一方面,尽管微软新发布的自研 AI 芯片表现出了不俗的竞争力,再加上 AMD 带来的威胁,让不少人和公司看到了打破英伟达算力霸权的希望。但事实上,英伟达 GPU 依然占据很大的优势,不管是去年发布 H100,还是前几天刚推出的 H200。

微软自研 AI 芯片,离英伟达 GPU 还有明显差距

微软发布自研 AI 芯片 Maia 100,估计没有人会感到意外。一是早前就有消息透露了这一点,二是地球上最大的几家云计算公司——谷歌、亚马逊都已经推出了自研 AI 芯片。当然,另一个直接因素还出在英伟达身上。

众所周知,英伟达 GPU 在事实上成为了大模型「硬件标准」,H100 成为了所有科技巨头都在囤积的战略资源,即便是远在 2020 年发布的 A100 依然能够引发「哄抢」。但一方面受限于产能,英伟达 GPU 始终供不应求;另一方面,英伟达 GPU 巨额的利润与大模型的烧钱战争,也引发了「只有英伟达在赚钱」的广泛讨论。

问题是,科技巨头没能在英伟达之外找到太好的选择,自研 AI 芯片反而可能是更好的选择。但以微软的 Maia 100 为例,自研 AI 芯片能够替代英伟达 GPU 了吗?

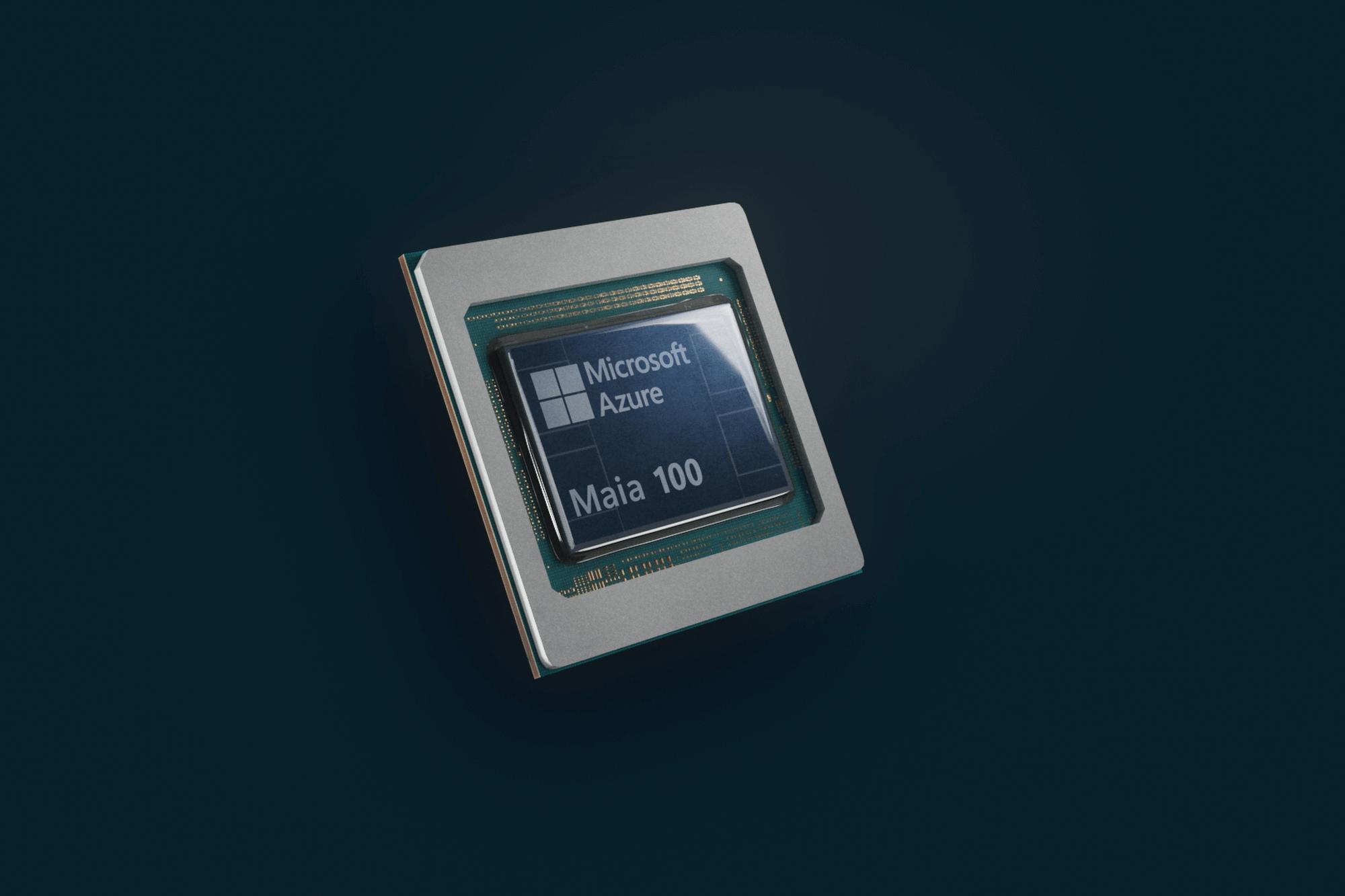

Maia 100,图/微软

按照纳德拉的说法,微软的自研 AI 芯片 Maia 100 基于英伟达 H100 同版本的台积电 5nm 工艺打造,晶体管数量达到了惊人的 1050 亿个。从公开数据来看,这颗芯片也是迄今为止最大的 AI 芯片。

半导体研究机构 SemiAnalysis 透露,Maia 100 在 MXInt8 下的性能为 1600 TFLOPS,在 MXFP4 下则达到了 3200 TFLOPS 的运算速度。同时据分析,自研 Maia 100 每年的成本大概也就在 1 亿美元左右。

如果单从数字来看,Maia 100 的算力完全碾压了谷歌的 TPUv5 以及亚马逊的 Trainium/Inferentia2 芯片,就算与英伟达 H100 相比,差距也不大了。

但需要指出的是,MXInt8、MXFP4 都是最新的数据格式,MXInt8 预期将替代 FP16/BF16,MXFP4 预期将替代 FP8。然而实际上,还没有任何公司基于这些新的数据格式训练过大模型,所以至少在训练环节上,Maia 100 的算力其实并不适合与其他 GPU 或者 AI 芯片进行直接比较。

另外值得一提的是,微软 Maia 100 拥有 1.6TB/s 的内存带宽,仍然碾压亚马逊的 Trainium/Inferentia2,但却逊于谷歌的 TPUv5,更不用说是英伟达 H100。

事实上,微软也明白「一口吃不成胖子」,Maia 100 距离替代英伟达 H100 乃至更新的型号还有很远的距离。据报道,Maia 100 采用直接液体冷却,目前仅为 GitHub Copilot 运行 GPT-3.5,明年也只是扩展到为 Azure 云的部分负载提供支持。

而就在几天前,英伟达刚刚发布了 H200 GPU,仅依靠大幅升级内存带宽和容量,就将大模型的训练和推理性能提升了 60%到 90%。

这可能也是为什么,在发布自研 AI 芯片 Maia 100 的同时,微软在 Ignite 大会依然宣布将与英伟达继续打造下一代 AI 超级计算机和工厂了。

Omniverse 与生成式 AI 的结合,比 Copilot 更重要

作为绝对的领先者,拥有最深的护城河,英伟达或许并没有太过重视微软自研 AI 芯片这件事。但显然,英伟达更在意还是 Copilot 之后,Omniverse 要如何结合生成式 AI 成为新时代「最大的一波浪潮」。

对于英伟达大力鼓吹的 Omniverse,可能很多人早已淡忘了,但肯定忘不了两年前的「真假黄仁勋」。

图/英伟达

2021 年 4 月,英伟达再次举办了一场线上「厨房」发布会,惯例由「黄仁勋」主讲。此后的三个多月,谁也没有发现这场发布会真正的神奇之处,直到英伟达在当年 8 月的 SIGGRAPH 大会上主动揭秘:

那场「厨房」发布会画面中的厨房、皮衣、烤箱……乃至「黄仁勋」本人以及他的动作、表情等等一切都是「假的」,或者更确切地说,是现实的「数字孪生」。

Omniverse 平台也是这个时候开始浮出水面,彼时「元宇宙」概念大热,也有人将其视为英伟达版本的元宇宙。但有一点是 Omniverse 和元宇宙截然不同的,英伟达想要创造一个数字孪生世界,核心目的在于影响现实世界。

虚拟铁路,图/英伟达

就像英伟达去年 GTC 大会提到的,德国铁路已经在 Omniverse 上构建、运营铁路轨道的「数字孪生」,包含了 5700 个站,全长 3 万多公里。而在这个「虚拟铁路」里,德国铁路能进行训练、验证 AI 模型,持续监控铁路、火车的运行情况,制造各种意外状况来发现问题对运营造成的影响。

最直接实际的价值是,基于在 Omniverse 上的测试和验证,能够在不需要造新轨道的同时,增加铁路运载容量和运行效率,降低碳排量。

通过「数字孪生」的测试验证,数字世界的结果能够指导现实世界,这就是黄仁勋对 Omniverse 始终推崇备至的核心原因之一。也是为什么,就算「元宇宙」概念已经被全世界抛弃,英伟达每一届 GTC 和 SIGGRAPH 大会都还在「推销」自己 Omniverse,包括这次在微软 Ignite 大会上也不例外。

当然,数字孪生技术也并非完美,目前最大的挑战可能还是成本。

两年前英伟达那场以假乱真的发布会上,数字孪生版本的「黄仁勋」实际只出场了 14 秒,但背后却是一系列的复杂工作,需要不小的人力、物力。与之相对的是,今年 SIGGRAPH 大会上展示的「从 PDF 到工厂」demo,实际就大量应用了生成式 AI 进行参与。

先将 2D 转成 3D,图/英伟达

基于 Omniverse 平台,通过与各种生成式 AI 的对话,就能将 2D 平面图转成完整的「数字孪生」。放在两年前,我们根本无法想象,但现实是,生成式 AI 已经向全世界证明了自身的实力和潜力。

而从这个角度来看,站在微软 CEO 纳德拉的旁边,老黄说出了「Copilot 很重要,但 Omniverse+生成式 AI 更重要」,就不难理解了。

题图来自微软 Ignite 大会

[免责声明]如需转载请注明原创来源;本站部分文章和图片来源网络编辑,如存在版权问题请发送邮件至398879136@qq.com,我们会在3个工作日内处理。非原创标注的文章,观点仅代表作者本人,不代表本站立场。