1月11日消息,阿里云今日宣布其第八代企业级通用计算实例ECS g8i算力再升级,国内首发代号Emerald Rapids的第五代英特尔至强可扩展处理器,依托阿里云自研的“飞天+CIPU”架构体系,ECS g8i实例的整机性能最高提升85%,AI推理性能最高提升7倍,可支撑高达72B参数的大语言模型,帮助中小规模模型起建成本降低50%。同时新实例还提供了端到端安全防护,为企业构建可信AI应用提供强有力的隐私增强算力支撑。

阿里云弹性计算产品线总经理张献涛表示,“阿里云ECS g8i实例的强劲表现,证明了以CPU为中心的计算体系同样具备加速AI推理的巨大潜力,公共云不仅可胜任超大规模的AI模型,也为AI应用加速落地开辟了新路径。”

英特尔中国数据中心和人工智能集团至强客户解决方案事业部总经理李亚东表示:“最新上市的第五代英特尔至强® 可扩展处理器每个内核均内置 AI 加速功能,完全有能力处理要求严苛的 AI 工作负载。与上代相比,其AI训练性能提升多达 29%,AI推理能力提升高达 42%。我们希望借由阿里云第八代企业级实例(ECS g8i)共同助力开发者实现技术普惠,让 AI 技术无处不在。”

通用算力再提升,整机性能提升85%

据介绍,作为企业级通用计算实例,ECS g8i实例在计算、存储、网络和安全等能力得到了全方位提升。从关键参数上看,ECS g8i实例的L3缓存容量提升到320MB,内存速率高达5600MT/s,整机性能提升85%,单核性能提升25%;存储方面,ESSD云盘提供100万 IOPS,全面搭载NVMe,存储延迟低至百微秒;网络方面,PPS高达3000万,标配阿里云自研eRDMA大规模加速能力,时延低至8微秒;安全方面,ECS g8i实例支持可信计算与加密计算等特性,全球率先支持机密虚拟机TDX技术,构建了全面的安全防护。

在E2E场景下,ECS g8i实例可将MySQL性能提升最高达60%,Redis和Nginx的性能分别提升40%和24%,面向游戏、视频直播、电商、金融、医疗、企业服务等行业提供强劲的算力支持,满足其在数据库、大数据、AI推理等应用场景下对性能的严苛要求。

此外,ECS g8i实例还提供了多种硬件原生加速能力,包括QAT和IAA等加速器。阿里云通过自研技术,将硬件加速能力更细颗粒度透传至实例虚拟机,小规格的ECS g8i实例也同样具备加速能力。其中,依托于QAT原生加解密加速器,ECS g8i实例在压缩/解压缩场景下性能最大可提升70倍,加解密性能提升4倍以上。

可支撑72B参数的大语言模型

生成式AI掀起的技术革命,正在推动计算范式发生根本性的变化。当前,AI大模型推理在算力上依然面临诸多挑战,例如首包延迟受限于并行处理能力与浮点运算能力,吞吐性能则受限于内存带宽和网络延迟。

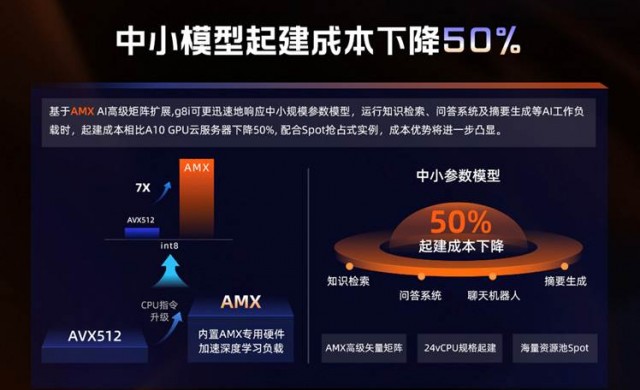

据介绍,阿里云ECS g8i实例针对这些难题都进行了相当程度的优化,包括内置指令集从AVX512升级到了Intel AMX高级矩阵扩展加速技术,可让生成式AI更快地运行。相对于AVX512指令集,启用AMX AI加速后,ECS g8i 实例在int 8矩阵计算的性能最高提升7倍。

基于AMX AI加速能力,g8i可更迅速地响应中小规模参数模型,运行知识检索、问答系统及摘要生成等AI工作负载时,起建成本相比A10 GPU云服务器下降50%。此外,配合阿里云平台的Spot抢占式实例,成本优势将进一步凸显,进一步降低AI推理成本。

与此同时,基于自研eRDMA超低延时弹性网络,阿里云g8i实例集群拥有超低延时网络和高弹性优势,可轻松支撑72B参数级别的大语言模型分布式推理,推理性能随集群规模接近线性加速,并可支持超过32batchsize的超大参数规模的AI模型负载,运行文生图、AI生成代码、虚拟助手以及创意辅助工具等AI工作负载。

以阿里云通义千问开源的Qwen-72B大模型为例,可在g8i实例eRDMA网络构建的集群实现高效运行,在输入小于500字情况下,首包延时小于3秒,每秒可生成7个Token。

最后,在安全方面,阿里云在全产品线构建了端到端的安全防护,可保障数据存储、数据传输、数据计算的全流程安全。在最底层,基于CIPU的安全架构搭载安全芯片TPM作为硬件可信根,实现服务器的可信启动,确保零篡改;虚拟化层面,支持虚拟可信能力vTPM,提供实例启动过程核心组件的校验能力;在实例可信的基础上支持不同平台的机密计算能力,实现了运行态的内存数据隔离和加密的保护。

值得一提的是,此次升级的ECS g8i实例全量支持Trust Domain Extension TDX 技术能力,业务应用无需更改,即可部署到 TEE 之中,极大降低了技术门槛,并以极低的性能损耗为大模型等AI应用提供隐私增强算力,护航大模型的云上数据安全。

以Qwen-Chat-7B模型为例,启用TDX后,既确保了模型推理的安全可信,也保护了数据的机密性和完整性。

“阿里云将不断深耕技术、持续产品创新,为企业提供更加稳定、强大、安全、弹性的计算服务,推动各行业的AI应用进入全量爆发时代。”张献涛表示。

[免责声明]如需转载请注明原创来源;本站部分文章和图片来源网络编辑,如存在版权问题请发送邮件至398879136@qq.com,我们会在3个工作日内处理。非原创标注的文章,观点仅代表作者本人,不代表本站立场。