OpenAI,一个承诺为全人类利益构建人工智能的公司,自去年推出 ChatGPT 以来,其商业雄心在最近的治理危机中变得更加显著。现在,该公司宣布,一个专注于管理未来超级智能 AI 的新研究小组开始取得成果。

OpenAI 研究员 Leopold Aschenbrenner 表示:「通用人工智能(AGI)正在迅速接近。我们将看到超人类模型,它们将具有巨大的能力,可能非常危险,我们还没有控制它们的方法。」OpenAI 已承诺将其五分之一的计算能力用于 Superalignment 项目。

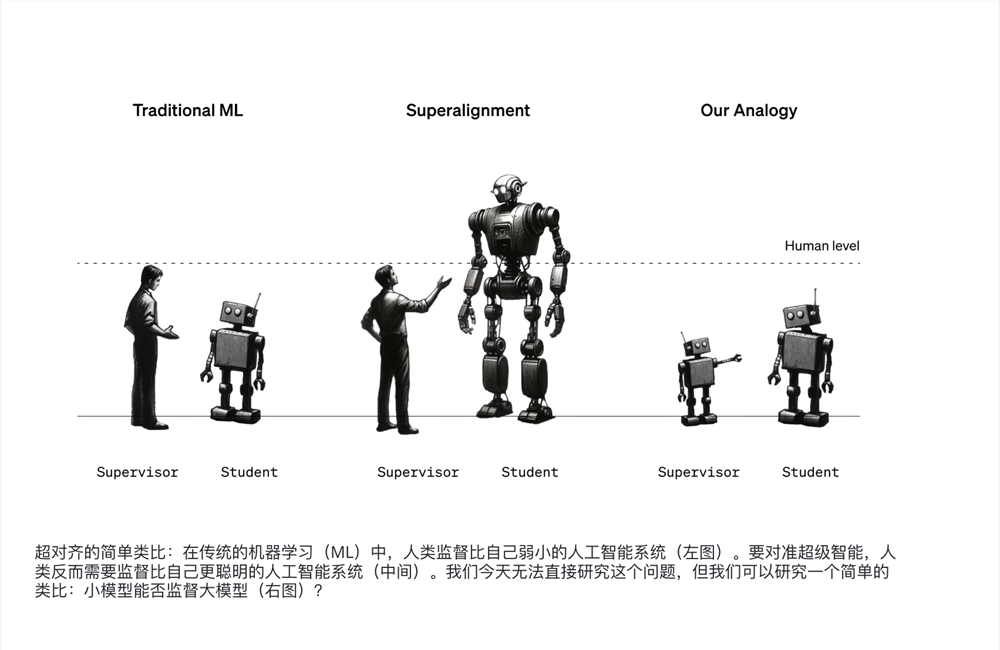

OpenAI 今天发布的一份研究报告展示了旨在测试一种让较弱 AI 模型引导更智能 AI 模型行为的实验结果。尽管所涉技术远未超越人类的灵活性,但这个场景被设计为代表将来人类必须与比自己更智能的 AI 系统协同合作的时期。

OpenAI 的研究人员检查了称为监督的过程,该过程用于调整像 GPT-4 这样的大型语言模型,使其更有帮助、减少危害。目前这包括人类对 AI 系统提供哪些答案好,哪些答案差的反馈。随着 AI 的进步,研究人员正在探索如何自动化这个过程,以节省时间,也因为他们认为当 AI 变得更强大时,人类提供有用的反馈可能变得不可能。

在一个使用 OpenAI 2019 年首次发布的 GPT-2 文本生成器教授 GPT-4 的对照实验中,较新系统的能力变得更弱,更类似于较差的系统。研究人员测试了两个解决这个问题的想法。一个是训练逐渐更大的模型来减少每一步的性能损失。在另一个中,团队对 GPT-4 添加了一种算法调整,允许更强大的模型在不太削弱其性能的情况下遵循较弱模型的指导。这种方法更有效,尽管研究人员承认,这些方法并不能保证更强大的模型将表现完美,并将其描述为进一步研究的起点。

截图来自 OpenAI

AI 安全中心主任 Dan Hendryks 表示:「很高兴看到 OpenAI 积极解决控制超人类 AI 的问题。我们将需要多年的专注努力来应对这一挑战。」

Aschenbrenner 和另外两名参与 Superintelligence 团队的成员 Collin Burns 和 Pavel Izmailov 告诉 WIRED,他们对他们所看到的驯服潜在超人类 AI 的重要第一步感到鼓舞。「即使六年级学生的数学知识不如大学数学专业的学生,他们仍然可以向大学生传达他们想要实现的目标。」Izmailov 说,「这就是我们现在试图实现的。」

Superalignment 小组由 OpenAI 联合创始人、首席科学家及董事会成员 Ilya Sutskever 共同领导。Sutskever 是今天发布的论文的合著者,但 OpenAI 拒绝让他讨论该项目。

在 Altman 上个月回归 OpenAI,并达成大部分董事会辞职的协议后,Sutskever 在公司的未来似乎充满不确定性。

Aschenbrenner 说:「我们非常感激 Ilya。他一直是项目的巨大动力和激励。」

OpenAI 的研究人员并不是第一次尝试使用今天的 AI 技术测试可能帮助驯服未来 AI 系统的技术。像以前在企业和学术实验室中的工作一样,目前无法知道在精心设计的实验中有效的想法是否会在未来实用。研究人员将他们正在尝试完善的让较弱 AI 模型训练更强大模型的能力描述为「超级对齐更广泛问题的一个关键组成部分」。

所谓的 AI 对齐实验也引发了关于任何控制系统可信度的问题。新 OpenAI 技术的核心依赖于更强大的 AI 系统自己决定可以忽略较弱系统的哪些指导,这可能会导致它忽略未来可能防止其不安全行为的信息。为了使这样的系统有用,需要在对齐方面取得进展。Burns 说:「你最终需要非常高度的信任。」

加州大学伯克利分校从事 AI 安全工作的教授 Stuart Russell 表示,使用较不强大的 AI 模型控制更强大模型的想法已经存在一段时间了。他还说,目前存在的教导 AI 行为的方法是否是前进的道路尚不清楚,因为它们到目前为止未能使当前模型可靠地行为。

尽管 OpenAI 正在宣传控制更先进 AI 的第一步,但该公司也热衷于征求外部帮助。该公司今天宣布,将与颇具影响力的投资者、谷歌前首席执行官 Eric Schmidt 合作,向外部研究人员提供 1000 万美元的资助,以促进包括弱对强监督、高级模型的可解释性以及加强模型抵御旨在破坏其限制的提示等主题的进一步发展。OpenAI 还将于明年举办一个关于超级对齐的会议,与新论文有关的研究人员说。

Sutskever 是 OpenAI 的联合创始人和 Superalignment 团队的共同领导,他领导了公司许多最重要的技术工作,是越来越多担心如何控制 AI 变得更强大的著名 AI 人物之一。今年,如何控制未来 AI 技术的问题引起了新的关注,这在很大程度上要归功于 ChatGPT。Sutskever 在深度神经网络先驱 Geoffrey Hinton 的指导下攻读了博士学位,后者今年 5 月离开谷歌,目的是警告 AI 现在似乎正在某些任务中迅速接近人类水平。

[免责声明]如需转载请注明原创来源;本站部分文章和图片来源网络编辑,如存在版权问题请发送邮件至398879136@qq.com,我们会在3个工作日内处理。非原创标注的文章,观点仅代表作者本人,不代表本站立场。