尽管Meta的新型Llama3迅速成为使用最广泛和定制程度最高的巨型语言模型(LLMs)排行榜榜首,但率先开启生成式人工智能时代的竞争对手OpenAI却通过为其GPT-4Turbo LLM和其他模型之上构建和编程引入新的企业级功能来摆脱竞争。

OpenAI今天宣布了其面向API客户的企业级功能的扩展,进一步丰富了其助手API,并引入了一些旨在增强安全性和管理控制权以及更有效地控制成本的新工具。

Private Link 和增强的安全功能

重大安全升级之一是引入 Private Link,这是一种安全方法,可以使 Microsoft 的 Azure 云服务与 OpenAI 之间进行直接通信,OpenAI 表示这有助于“减少通过 API 发送的客户数据和查询暴露给开放互联网”。

此举补充了现有的安全堆栈,该堆栈包括 SOC2Type II 认证、单点登录 (SSO)、静止状态下的 AES-256数据加密、传输中的 TLS1.2加密和基于角色的访问控制。

此外,OpenAI 还引入了原生多因素身份验证 (MFA) 来加强访问控制,以符合不断增长的合规性需求。

对于需要 HIPAA 合规的医疗保健公司,OpenAI 继续提供商业伙伴协议以及针对符合条件的 API 客户的零数据保留政策。

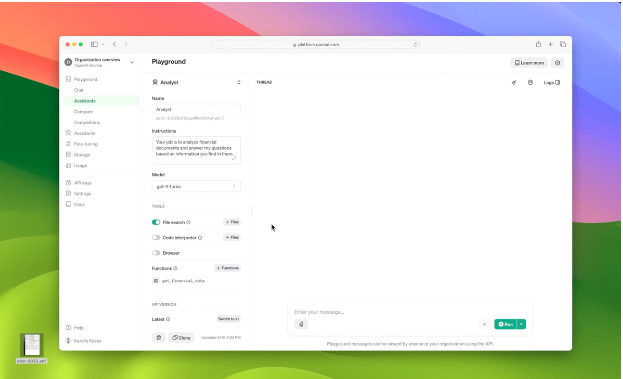

升级后的助手API 可处理500倍以上的文件

OpenAI 最不为人知但最重要的企业产品之一是其助手 API,它允许企业部署他们训练过的自定义微调模型,并通过检索增强型生成 (RAG) 调用特定文档,以便在其自己的应用程序中提供对话式助理。

例如,电子商务公司 Klarna 今年早些时候吹嘘其由 OpenAI 助手 API 制作的 AI 助手如何能够完成700名全职人类代理的工作,重复查询减少了25%,解决时间几乎减少了82%(从11分钟减少到2分钟)。

OpenAI 现在已升级助手 API,包括增强的文件检索功能,其中包含新的“file_search”功能,该功能可以每个助手处理多达10,000个文件。

这代表比以前的20个文件限制增加了500倍,并增加了并行查询、改进的重新排序和查询重写等附加功能。

此外,API 现在支持实时对话响应的流式传输,这意味着诸如 GPT-4Turbo 或 GPT-3.5Turbo 之类的 AI 模型将尽所能生成令牌,而无需等待完整响应。

它进一步集成了用于更好文件管理的新“vector_store”对象,并提供了对令牌使用的更细粒度控制,以帮助有效控制成本。

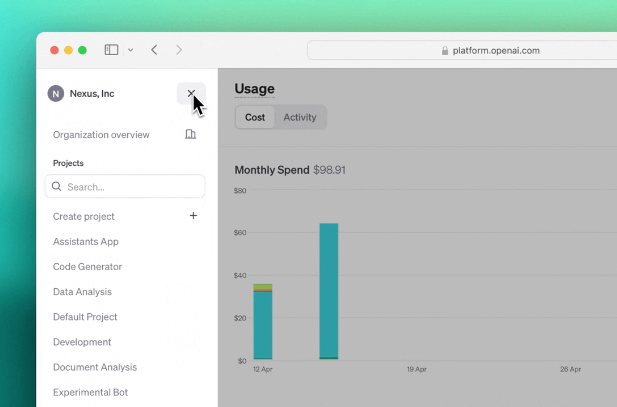

Projects使企业能够控制和划分对特定任务和分配的访问权限

名为“Projects”的新功能通过允许组织在项目级别管理角色和 API 密钥,从而改善了管理监督。

此功能允许企业客户设置权限范围、控制可用模型并设置基于使用量的限制以避免意外成本 - 这些改进承诺将大大简化项目管理。

基本上,他们可以将 AI 模型的微调版本甚至普通版本隔离到一组特定的任务或文档,并允许特定的人员处理其中每一个。

因此,如果您公司的一个团队使用一套面向公众的文档,另一个团队使用一套机密或内部文档,那么您可以在 OpenAI 的 API 中为每个团队分配一个单独的项目,并且这两个团队都可以使用 AI 模型来处理这些文档,而不会混合或危及后者。

官方博客:https://openai.com/blog/more-enterprise-grade-features-for-api-customers

[免责声明]如需转载请注明原创来源;本站部分文章和图片来源网络编辑,如存在版权问题请发送邮件至398879136@qq.com,我们会在3个工作日内处理。非原创标注的文章,观点仅代表作者本人,不代表本站立场。